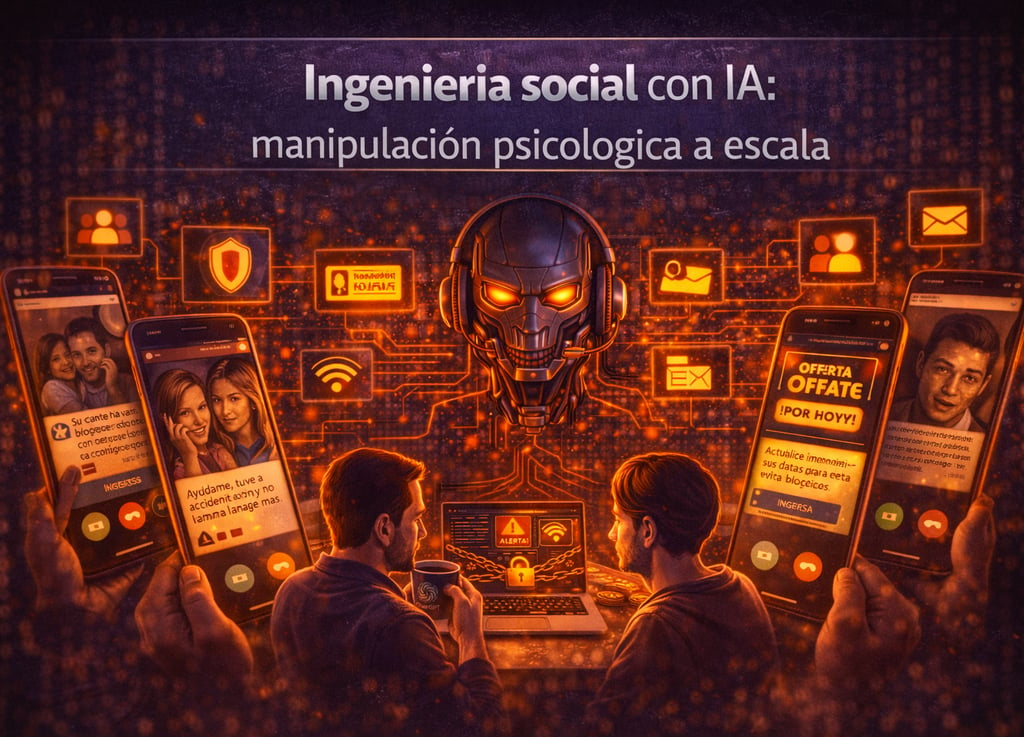

Ingeniería social con IA: manipulación psicológica a escala

Isaac Ruiz Romero

2/10/20264 min read

Ingeniería social con IA: manipulación psicológica a escala

Cuando el ataque ya no va contra sistemas, sino contra personas

Durante años, la ciberseguridad se centró en proteger máquinas: firewalls, antivirus, parches, servidores. Pero algo ha cambiado. Hoy, el objetivo principal de los ataques ya no es el sistema… eres tú.

La ingeniería social, la técnica que manipula a las personas para que hagan lo que un atacante quiere, siempre ha existido. Lo nuevo es que ahora cuenta con una aliada poderosa: la inteligencia artificial. Y esa combinación ha llevado la manipulación psicológica a una escala nunca vista.

Ya no hablamos de engaños improvisados ni de estafas genéricas. Hablamos de ataques diseñados para entender cómo piensas, cómo reaccionas y cuándo eres más vulnerable.

De engaños artesanales a manipulación industrial

Antes, la ingeniería social requería tiempo y habilidad humana. Un atacante tenía que estudiar a su víctima, preparar un mensaje creíble y esperar que funcionara. Eso limitaba el alcance.

La IA ha eliminado esa limitación.

Hoy, un solo atacante puede lanzar miles de ataques personalizados al mismo tiempo, adaptados a distintos perfiles, contextos y emociones. No es magia. Es automatización del comportamiento humano.

La manipulación ya no es artesanal. Es industrial.

Cómo la IA aprende a manipularte

La inteligencia artificial no improvisa. Aprende observando datos. Y esos datos están, en gran parte, en abierto.

Redes sociales, perfiles profesionales, comentarios, likes, fotos, vídeos, horarios, rutinas… Todo eso permite a la IA construir un perfil psicológico sorprendentemente preciso.

A partir de ahí, puede:

Ajustar el tono (urgente, cercano, autoritario)

Elegir el momento adecuado

Usar referencias personales creíbles

Activar emociones concretas: miedo, confianza, culpa, urgencia

El mensaje no se envía “a ver si cuela”. Se envía porque tiene altas probabilidades de funcionar.

El gran cambio: ya no hay señales evidentes

Durante años, nos enseñaron a detectar estafas fijándonos en errores. Ortografía deficiente, mensajes genéricos, incoherencias. Esa defensa ya no sirve.

La IA escribe mejor que muchas personas.

Imita estilos de comunicación.

Usa contexto real.

El mensaje no parece sospechoso. Parece normal.

Y cuando algo parece normal, bajamos la guardia.

Ataques que se adaptan en tiempo real

Uno de los aspectos más peligrosos de la ingeniería social con IA es que el ataque puede evolucionar mientras interactúas con él.

Si dudas, insiste con otro argumento.

Si no respondes, cambia el enfoque.

Si haces una pregunta, responde con coherencia.

No es un mensaje estático. Es una conversación diseñada para llevarte a una acción concreta.

Aquí ya no hablamos de phishing clásico. Hablamos de manipulación psicológica asistida por máquina.

Empresas: el objetivo perfecto

En el entorno empresarial, este tipo de ataques es especialmente efectivo. La IA permite estudiar:

Organigramas

Cargos y responsabilidades

Relaciones internas

Lenguaje corporativo

Con eso, se crean mensajes que imitan a proveedores, directivos o compañeros de trabajo. Un correo o mensaje bien escrito, en el momento adecuado, puede provocar:

Transferencias fraudulentas

Entrega de credenciales

Accesos no autorizados

Instalación de malware

Y todo sin explotar una sola vulnerabilidad técnica.

Familias y particulares: emociones como puerta de entrada

En el ámbito personal, la manipulación se apoya aún más en las emociones. Mensajes que apelan al miedo, al cariño o a la urgencia: un hijo, un familiar, un problema inesperado.

La IA no necesita conocer a la persona. Le basta con parecer que la conoce.

Cuando el mensaje encaja con tu realidad, el pensamiento crítico desaparece durante unos segundos. Y eso es suficiente.

El mayor error: pensar que esto solo afecta a “otros”

Uno de los grandes problemas de la ingeniería social es la confianza excesiva. Muchas personas creen que sabrían detectar un engaño. La realidad es que estos ataques no se basan en falta de inteligencia, sino en reacciones humanas normales.

La IA no ataca tu conocimiento técnico. Ataca:

Tu prisa

Tu empatía

Tu confianza

Tu sentido de la responsabilidad

Y eso nos afecta a todos.

Cómo defenderse cuando el ataque es psicológico

La defensa frente a la ingeniería social con IA no pasa solo por más tecnología, sino por cambiar hábitos y procesos.

Algunas claves fundamentales:

Desconfiar de urgencias inesperadas

No tomar decisiones críticas bajo presión

Verificar siempre por un segundo canal

Establecer protocolos claros en empresas y familias

Asumir que lo “bien hecho” también puede ser falso

La conciencia es la primera barrera de seguridad.

La nueva realidad: la ciberseguridad es humana

La ingeniería social con IA nos obliga a aceptar una verdad incómoda:

la ciberseguridad ya no va solo de sistemas, va de personas.

Cuanto más humana parece la tecnología, más necesitamos criterio, formación y cultura digital.

aprende a protegerte de la manipulación digital

Si quieres entender:

Cómo funcionan estos ataques en la práctica

Qué señales siguen delatándolos

Cómo proteger a tu empresa o a tu familia

Qué protocolos simples puedes aplicar desde hoy

He preparado una guía práctica en PDF, clara y sin tecnicismos, para ayudarte a detectar y prevenir ataques de ingeniería social impulsados por IA.

📥 Descargar gratis: “Ingeniería social con IA: cómo protegerte de la manipulación digital”

Porque hoy, el mayor riesgo no es un fallo técnico… es una decisión tomada bajo presión.

Contacto

Número de teléfono

+34 640 81 78 31

© 2026. All rights reserved.