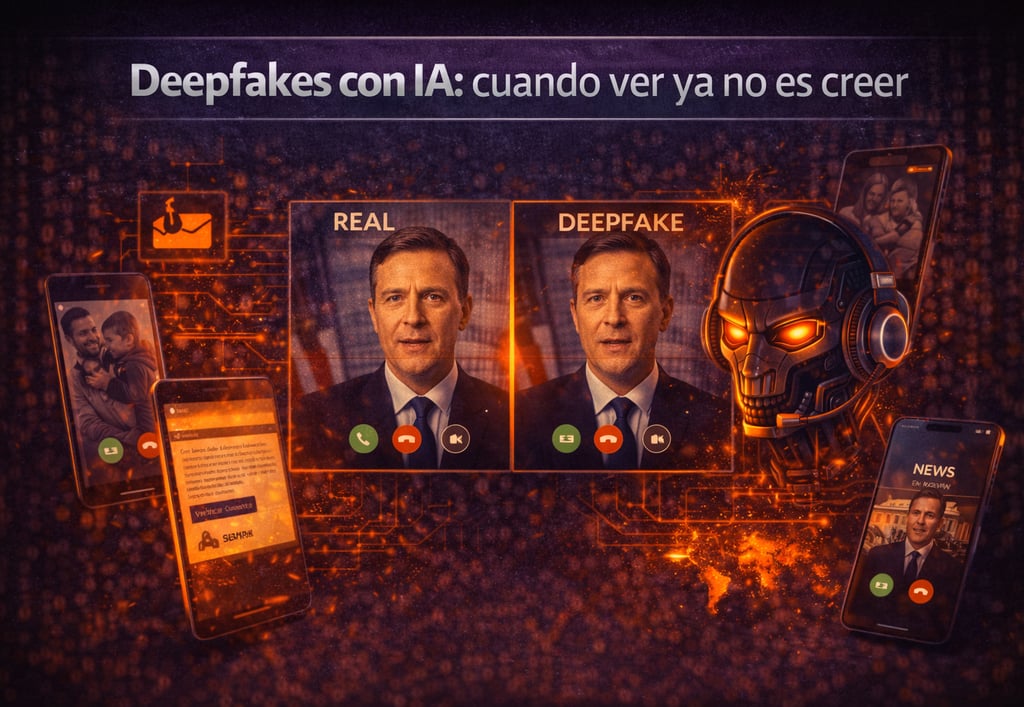

Deepfakes con IA: cuando ver ya no es creer

Isaac Ruiz Romero

2/8/20263 min read

Deepfakes con IA: cuando ver ya no es creer

La imagen siempre fue una prueba. Hasta ahora.

Durante décadas nos enseñaron una regla básica: si lo ves, es real. Una foto, un vídeo o una grabación tenían un peso casi definitivo. Servían como prueba, como evidencia, como verdad.

Hoy esa regla se está rompiendo.

La inteligencia artificial ha dado lugar a una tecnología capaz de crear imágenes, vídeos y audios falsos tan realistas que incluso expertos dudan. Son los llamados deepfakes, y no son un experimento de laboratorio ni una curiosidad viral. Son una herramienta cada vez más utilizada en fraudes, extorsiones, campañas de desinformación y ataques dirigidos.

Ver ya no es creer.

Qué es realmente un deepfake (y por qué debería preocuparte)

Un deepfake es un contenido audiovisual generado o alterado con inteligencia artificial para imitar la apariencia, la voz o los gestos de una persona real. La IA aprende a partir de imágenes, vídeos o audios públicos —redes sociales, entrevistas, vídeos familiares— y los reproduce con una precisión inquietante.

No hablamos de montajes burdos. Hablamos de:

Vídeos donde una persona dice cosas que nunca dijo

Audios con la voz exacta de un familiar, un jefe o un directivo

Imágenes falsas que parecen sacadas de una cámara real

El problema no es solo la tecnología. El verdadero riesgo es la confianza automática que seguimos depositando en lo visual.

De los memes al crimen digital

Los primeros deepfakes se popularizaron como entretenimiento: vídeos virales, bromas, imitaciones. Pero esa etapa quedó atrás.

Hoy se utilizan para:

Estafas económicas

Suplantación de identidad

Chantaje y extorsión

Manipulación de la opinión pública

Daños reputacionales irreversibles

Y lo más peligroso es que no requieren grandes conocimientos técnicos. Muchas herramientas están disponibles públicamente, con interfaces sencillas y resultados inmediatos.

Casos reales: cuando la IA cruza la línea

En los últimos años ya hemos visto ejemplos muy claros del impacto real de los deepfakes:

Fraudes empresariales donde empleados recibieron llamadas de “directivos” solicitando transferencias urgentes. La voz era idéntica. El dinero nunca volvió.

Extorsiones a particulares, usando vídeos falsos para amenazar con difundir contenido comprometido que nunca existió.

Manipulación política y social, con vídeos falsos difundidos en momentos clave para generar confusión o desconfianza.

En todos los casos hay un patrón común: la víctima confió porque “lo vio” o “lo escuchó”.

El impacto emocional: el daño que no se mide en dinero

Más allá de las pérdidas económicas, los deepfakes generan un impacto profundo:

Miedo

Vergüenza

Desconfianza

Duda constante sobre lo que es real

Para familias, supone un riesgo directo: una llamada falsa de un hijo, una imagen manipulada, una amenaza creíble.

Para empresas, el daño reputacional puede ser devastador incluso aunque el contenido sea desmentido después.

La IA no solo roba dinero. Roba seguridad y confianza.

Por qué cada vez será peor (y más común)

La tecnología avanza rápido, pero hay tres factores que aceleran el problema:

Más datos públicos

Cada foto, vídeo o audio que subimos alimenta estos sistemas.

Herramientas más accesibles

Ya no hacen falta conocimientos avanzados ni grandes recursos.

Ataques cada vez más personalizados

Un deepfake genérico puede fallar. Uno dirigido a una persona concreta tiene muchas más probabilidades de éxito.

El resultado es claro: los deepfakes pasarán de ser excepcionales a cotidianos.

Cómo protegerse cuando la imagen ya no es fiable

La defensa frente a los deepfakes no consiste en desconfiar de todo, sino en cambiar nuestros hábitos de verificación.

Algunas claves esenciales:

Nunca tomar decisiones urgentes basadas solo en un audio o vídeo

Verificar por un segundo canal (llamada directa, mensaje interno, contacto conocido)

Establecer palabras clave o protocolos familiares

Formar a empleados y equipos en este tipo de amenazas

Asumir que lo visual ya no es una prueba definitiva

La prevención empieza por aceptar una realidad incómoda: pueden imitar a cualquiera.

El mayor error: pensar “a mí no me va a pasar”

Muchos deepfakes no buscan a personas famosas. Buscan a personas normales, empresas medianas, familias comunes. Porque ahí hay menos controles y más confianza.

El ataque no se basa en la tecnología, sino en la reacción humana: el miedo, la urgencia, la autoridad, el cariño.

Y eso nos afecta a todos.

aprende a detectar lo que la IA quiere que creas

Si quieres saber:

Cómo reconocer señales de deepfakes

Qué hacer si recibes un audio o vídeo sospechoso

Cómo proteger a tu familia o tu empresa

Qué protocolos simples puedes aplicar desde hoy

He preparado un PDF práctico y claro, pensado para personas no técnicas, donde explico cómo defenderse de la suplantación con IA y deepfakes.

📥 Descargar gratis el PDF:“Deepfakes y suplantación con IA: cómo protegerte cuando ver ya no es creer”

Porque en esta nueva etapa digital, la confianza sin verificación es el mayor riesgo.

Contacto

Número de teléfono

+34 640 81 78 31

© 2026. All rights reserved.