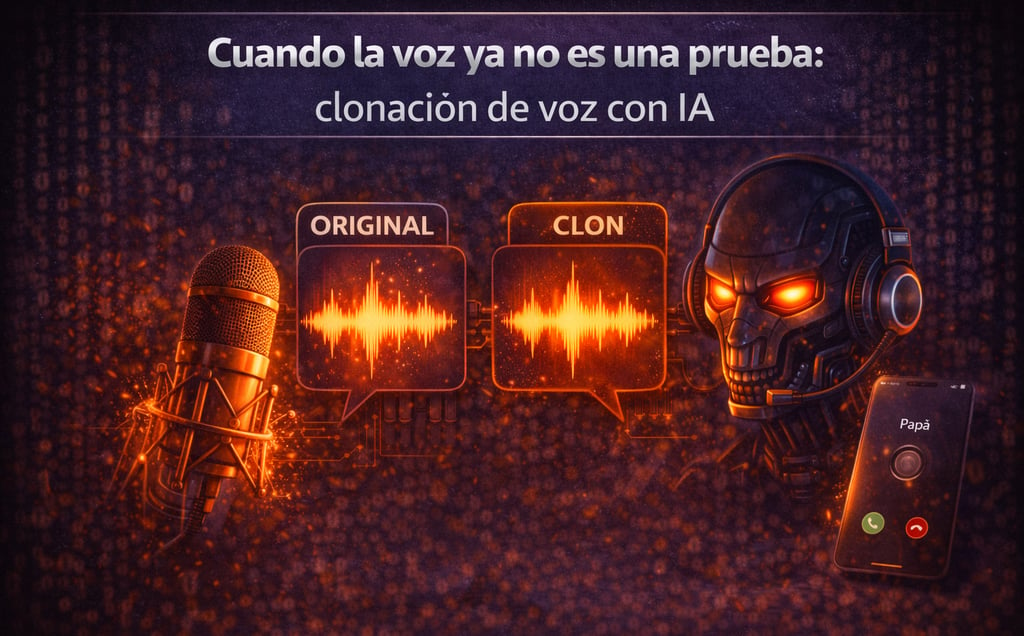

Cuando la voz ya no es una prueba: clonación de voz con IA

Si suena como tu jefe, tu hijo o tu banco… ¿por qué no iba a ser real? Durante décadas, la voz fue una prueba. Si reconocías a alguien al otro lado del teléfono, confiabas. La voz transmitía identidad, cercanía y seguridad. Hoy, esa certeza ha desaparecido.

CIBERSEGURIDAD PARA TODOS

Isaac Ruiz Romero

Cuando la voz ya no es una prueba: la clonación de voz con inteligencia artificial

Si suena como tu jefe, tu hijo o tu banco… ¿por qué no iba a ser real?

Durante décadas, la voz fue una prueba. Si reconocías a alguien al otro lado del teléfono, confiabas. La voz transmitía identidad, cercanía y seguridad. Hoy, esa certeza ha desaparecido.

La clonación de voz con inteligencia artificial ha roto una de las últimas barreras de confianza digital. Ya no hace falta hackear un sistema: basta con imitar una voz para engañar a una persona.

Y lo más inquietante es esto: funciona.

El engaño perfecto: cuando la tecnología imita a las personas

Hoy, con apenas unos segundos de audio extraídos de un vídeo, una nota de voz o una llamada grabada, es posible crear una copia casi perfecta de la voz de cualquier persona. No hablamos de ciencia ficción, sino de herramientas reales, accesibles y cada vez más precisas.

El resultado es devastador para la seguridad:

Voces que suenan exactamente igual

Entonación, pausas y acento creíbles

Mensajes coherentes y contextuales

Cuando escuchas la voz, tu cerebro deja de analizar. Confía.

Casos reales: cuando nadie sospecha

Ya existen casos documentados de empresas que han transferido grandes cantidades de dinero tras recibir una llamada de un supuesto directivo. La voz era idéntica. El tono, el estilo y la urgencia encajaban perfectamente.

También se han detectado estafas a familias, donde una llamada simulaba la voz de un hijo o un familiar pidiendo ayuda urgente. El miedo y la presión emocional hacen el resto.

En la mayoría de estos casos, las víctimas dicen lo mismo después:

“No dudé porque era su voz”.

Por qué este tipo de estafa es tan peligrosa

La clonación de voz con IA ataca directamente a uno de los pilares de la confianza humana. No depende de enlaces, correos mal escritos ni errores técnicos. Depende de emociones.

Este tipo de fraude:

Evita filtros de seguridad tradicionales

Funciona por llamada telefónica o nota de voz

No deja rastro técnico evidente

Explota la urgencia y la autoridad

Y afecta especialmente a:

Empresas con procesos poco definidos

Departamentos financieros y directivos

Personas mayores

Familias con alta exposición en redes sociales

El error más común: “a mí no me pasaría”

Muchas personas y empresas creen que sabrían detectar una estafa así. La realidad es que cuando la voz es correcta y el contexto encaja, la capacidad crítica se reduce drásticamente.

La IA no improvisa. Analiza información pública, aprende patrones de comunicación y replica comportamientos humanos. No intenta parecer real. Lo es, a efectos prácticos.

Cómo protegerse cuando la voz ya no es suficiente

La defensa frente a este tipo de ataques no es técnica, es organizativa y cultural. Algunas medidas clave:

No tomar decisiones críticas basadas solo en una llamada

Verificar siempre por un segundo canal

Establecer palabras clave o protocolos internos

Desconfiar de urgencias inesperadas

Limitar la exposición pública de audios y vídeos

En empresas, esto debe traducirse en procedimientos claros. En familias, en conversaciones previas y acuerdos de verificación.

El impacto real: más allá del dinero

El daño de estas estafas no es solo económico. Dejan:

Sensación de vulnerabilidad

Pérdida de confianza

Estrés emocional

Dudas sobre la propia capacidad de juicio

Cuando ya no puedes confiar en lo que escuchas, la seguridad digital entra en una nueva fase.

La nueva realidad: la identidad necesita más pruebas

Estamos entrando en una etapa donde la voz ya no es una prueba de identidad. Igual que ocurrió con los correos electrónicos o los mensajes, ahora le toca a las llamadas.

La ciberseguridad ya no va solo de sistemas, va de procesos, educación y anticipación. Quien no se adapte, quedará expuesto.

👉 Protégete antes de que alguien use tu voz

Si quieres aprender:

Cómo funcionan realmente estas estafas

Qué señales permiten detectarlas

Cómo proteger a tu empresa o a tu familia

Qué protocolos implementar desde hoy

He preparado una guía práctica en PDF, clara y sin tecnicismos, para entender y prevenir estafas con clonación de voz e IA.

📥 Descargar gratis: “Cómo protegerte de estafas con clonación de voz e inteligencia artificial”

No esperes a que una llamada “convincente” te obligue a aprender por las malas.

Contacto

Número de teléfono

+34 640 81 78 31

© 2026. All rights reserved.